1. はじめに

生成AIの進化と普及は、企業活動に革新をもたらす一方で、これまでにないリスクも顕在化しています。

誤情報の生成、著作権侵害、プライバシー漏洩など、生成AI特有の課題も存在しており、企業がこれらのリスクを事前に認識し、適切に対応することが求められます。

こうした背景の中、米国国立標準技術研究所(NIST)が策定した「AIリスクマネジメントフレームワーク(AI RMF)」は、生成AIを含むAI技術のリスクを体系的に評価・管理するための有力な枠組みとして注目されています。

本稿では、AI RMFを活用した生成AIのリスク評価について、現状と実践方法を交えて解説します。

2. 生成AIの現状

生成AIとは、大量のデータを学習し、自然言語、画像、音声、プログラムコードなどの新しいコンテンツを自動的に生成する人工知能技術です。従来のAIが「分類」や「予測」といった分析的なタスクを得意としていたのに対し、生成AIは「創造的な出力」を行う点が特徴です。

この技術は、自然言語処理や画像処理、音声合成、設計支援などの分野で活用されており、企業においても業務効率化や製品開発、顧客対応、教育支援など、さまざまな用途で導入が進んでいます。

上記の図表は以下の情報を参考に三優監査法人で活用事例を整理した図表である。

<(令和7年6月6日)生成AIに関する実態調査報告書ver.1.0 (令和7年6月6日)生成AIに関する実態調査報告書ver.1.0について | 公正取引委員会 閲覧日 2025/8/26>

<テキスト生成AIの導入・運用ガイドライン テキスト生成AIの導入・運用ガイドライン | デジタル人材の育成 | IPA 独立行政法人 情報処理推進機構 閲覧日 2025/8/26>

こうした多様な分野での活用が進む一方で、生成AIの導入には慎重な検討も求められます。特に企業においては、利便性や創造性の向上だけでなく、リスクへの対応も重要な課題となります。

3. 生成AI利用時のリスク

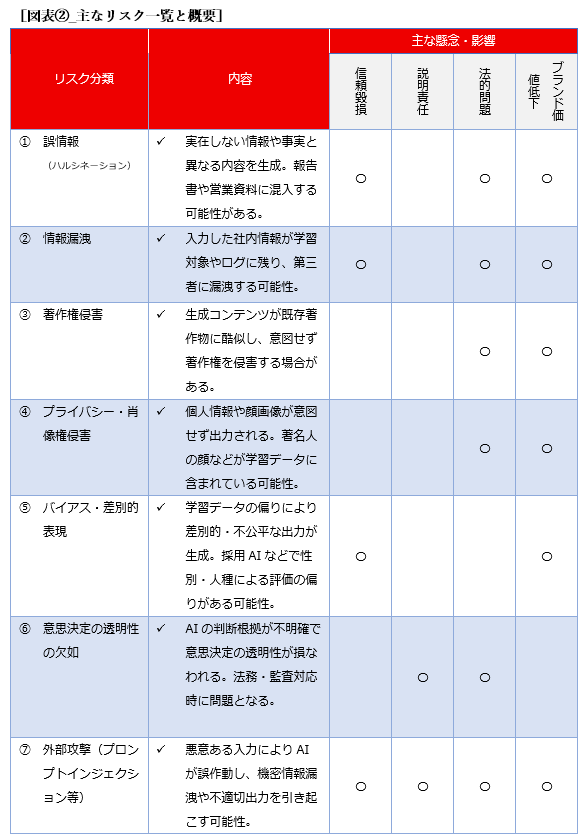

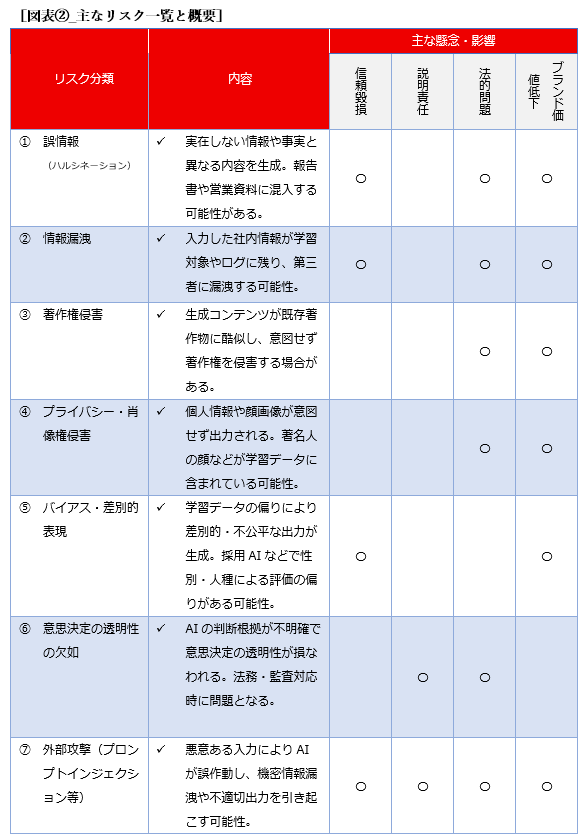

生成AIは業務効率化や創造性の向上に寄与する一方で、企業にとって無視できないリスクも内包しています。特に以下の7つのリスクは、導入前・運用中の両方で注意が必要です。

上記の図表は以下の情報を参考に三優監査法人でリスクを整理した図表である。

<AI Risk Management Framework AI Risk Management Framework | NIST 閲覧日 2025/8/26>

これらのリスクは単独で発生するだけでなく、連鎖的に他のリスクを引き起こす可能性があります。たとえば、誤情報の生成が著作権侵害やプライバシー・肖像権侵害につながるケースもあります。

リスクを捉える場合には、企業は単なる注意喚起にとどまらず、体系的なリスク管理の枠組みを持つことが求められます。そこで参考となるのが、米国国立標準技術研究所(NIST)が策定した「AIリスクマネジメントフレームワーク(AI RMF)」です。

4. 米国国立標準技術研究所(NIST)「AIリスクマネジメントフレームワーク(AI RMF)」の概要

米国国立標準技術研究所(NIST)が2023年1月に発表した「AIリスクマネジメントフレームワーク(AI RMF)」は、AI技術の設計・開発・運用・評価におけるリスクを体系的に管理するためのガイドラインです。企業や公共機関が信頼できるAIを実現するための枠組みとして、企業や公共機関が信頼できるAIを実現するために設計されています。

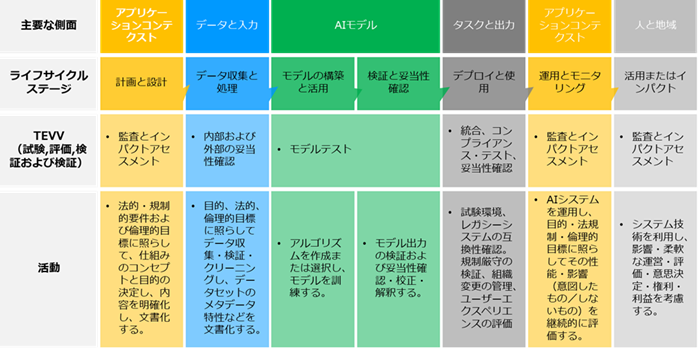

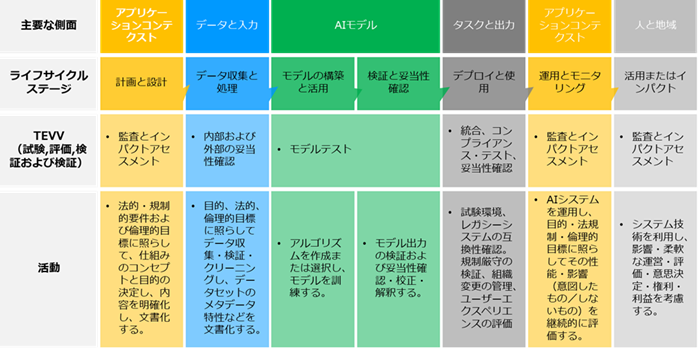

NIST AI RMFでは、AIのリスクを適切に管理するために、AIシステムのライフサイクル全体を通じた取り組みが重要であるとされています。

このライフサイクルは、AIの企画段階から運用・活用に至るまでの各ステージでリスクと影響を見極め整理しています。

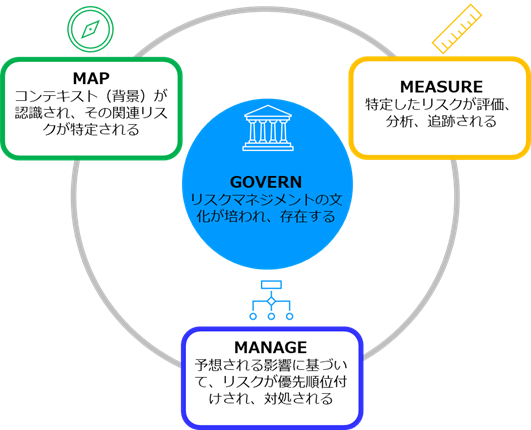

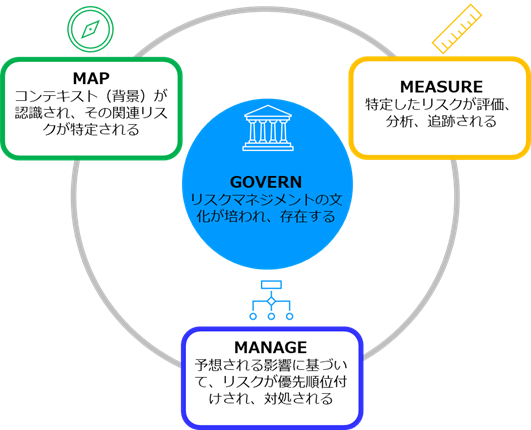

NISTのAIリスクマネジメントフレームワーク(AI RMF)では、AIのリスクをうまく管理し、信頼できるAIをつくるために、「コア」と呼ばれる考え方が使われています。

この「コア」は、次の4つの活動(機能)でできています

①GOVERN(統治)

✓ AIのリスク管理を組織としてどう進めるか、ルールや体制を整える活動です。他の3つの活動を支える土台になります。

②MAP(把握)

✓ AIに関わるリスクを見つけて、どんな影響があるかを理解する活動です。

③MEASURE(測定)

✓ リスクの大きさやAIの性能などを、データや指標を使って評価する活動です。

④MANAGE(対応)

✓ 見つけたリスクに対して、どう対応するかを決めて実行する活動です。

以下の内容を参考にAI RMF のライフサイクルと概要を整理した。

<NIST AI 100-1AI リスクマネジメント フレームワーク(AI RMF 1.0) Artificial Intelligence Risk Management Framework (AI RMF 1.0) 閲覧日 2025/8/26>

<NIST AI リスクマネジメントフレームワークプレイブック Artificial Intelligence Risk Management Framework Playbook (AI RMF 1.0 Playbook) Japanese Translation 閲覧日 2025/8/26>

これらは、AIのライフサイクル全体にわたって継続的に実施されるべき活動であり、組織が信頼性の高いAIを実現するための土台となります。

次に、こうしたフレームワークを実際の業務にどのように適用できるのか、導入前~導入後の場面を例に、リスク評価の具体的なイメージをご紹介します。

5. 実際のリスク評価のイメージ

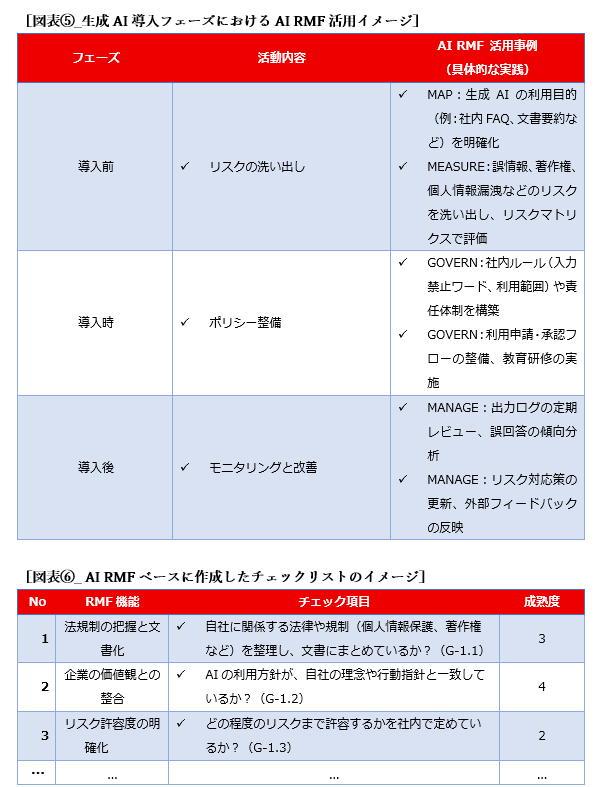

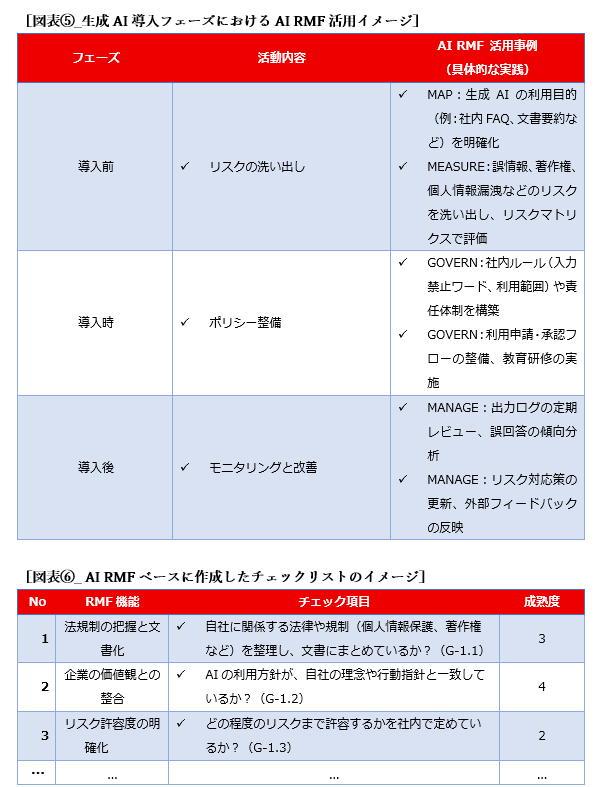

企業が生成AIを導入する際には、技術的な可能性だけでなく、リスクや責任の観点からの慎重な検討が不可欠です。

NISTのAIリスクマネジメントフレームワーク(AI RMF)は、導入前・導入時・運用後の各フェーズで、AIのリスクを体系的に管理するための実践的な枠組みを提供しています。

以下では、企業が生成AIを活用する際に、AI RMFの各機能(MAP、MEASURE、GOVERN、MANAGE)をどのように活用できるかを、フェーズごとに具体的に示します。

以下の内容を参考に活用イメージとチェックリストイメージを整理した

<NIST AI 100-1AI リスクマネジメント フレームワーク(AI RMF 1.0) Artificial Intelligence Risk Management Framework (AI RMF 1.0) 閲覧日 2025/8/26>

<NIST AI リスクマネジメントフレームワークプレイブック Artificial Intelligence Risk Management Framework Playbook (AI RMF 1.0 Playbook) Japanese Translation 閲覧日 2025/8/26>

このように、AI RMFを活用することで、企業は生成AIの導入に伴うリスクを事前に把握し、導入後も継続的に監視・改善する体制を整えることが可能になります。

特に、導入前の準備と運用中のモニタリングを丁寧に行うことで、予期せぬリスクの顕在化を防ぎ、信頼性の高いAI活用が実現可能になると考えます。

6. 終わりに

AIの活用を検討する企業にとって、AI技術に内在するリスクを体系的に評価・管理することは、事業継続性や信頼性を確保するうえで不可欠です。特に、法規制や倫理的配慮、情報セキュリティといった観点からのリスク対応は、企業価値の維持・向上にも直結します。

AIのリスク評価に関してのご相談がございましたら、ぜひお気軽にお問い合わせください。

お問い合わせは、以下の窓口よりお願いいたします。

Contact Us - BDO

生成AIの進化と普及は、企業活動に革新をもたらす一方で、これまでにないリスクも顕在化しています。

誤情報の生成、著作権侵害、プライバシー漏洩など、生成AI特有の課題も存在しており、企業がこれらのリスクを事前に認識し、適切に対応することが求められます。

こうした背景の中、米国国立標準技術研究所(NIST)が策定した「AIリスクマネジメントフレームワーク(AI RMF)」は、生成AIを含むAI技術のリスクを体系的に評価・管理するための有力な枠組みとして注目されています。

本稿では、AI RMFを活用した生成AIのリスク評価について、現状と実践方法を交えて解説します。

2. 生成AIの現状

生成AIとは、大量のデータを学習し、自然言語、画像、音声、プログラムコードなどの新しいコンテンツを自動的に生成する人工知能技術です。従来のAIが「分類」や「予測」といった分析的なタスクを得意としていたのに対し、生成AIは「創造的な出力」を行う点が特徴です。

この技術は、自然言語処理や画像処理、音声合成、設計支援などの分野で活用されており、企業においても業務効率化や製品開発、顧客対応、教育支援など、さまざまな用途で導入が進んでいます。

上記の図表は以下の情報を参考に三優監査法人で活用事例を整理した図表である。

<(令和7年6月6日)生成AIに関する実態調査報告書ver.1.0 (令和7年6月6日)生成AIに関する実態調査報告書ver.1.0について | 公正取引委員会 閲覧日 2025/8/26>

<テキスト生成AIの導入・運用ガイドライン テキスト生成AIの導入・運用ガイドライン | デジタル人材の育成 | IPA 独立行政法人 情報処理推進機構 閲覧日 2025/8/26>

こうした多様な分野での活用が進む一方で、生成AIの導入には慎重な検討も求められます。特に企業においては、利便性や創造性の向上だけでなく、リスクへの対応も重要な課題となります。

3. 生成AI利用時のリスク

生成AIは業務効率化や創造性の向上に寄与する一方で、企業にとって無視できないリスクも内包しています。特に以下の7つのリスクは、導入前・運用中の両方で注意が必要です。

上記の図表は以下の情報を参考に三優監査法人でリスクを整理した図表である。

<AI Risk Management Framework AI Risk Management Framework | NIST 閲覧日 2025/8/26>

これらのリスクは単独で発生するだけでなく、連鎖的に他のリスクを引き起こす可能性があります。たとえば、誤情報の生成が著作権侵害やプライバシー・肖像権侵害につながるケースもあります。

リスクを捉える場合には、企業は単なる注意喚起にとどまらず、体系的なリスク管理の枠組みを持つことが求められます。そこで参考となるのが、米国国立標準技術研究所(NIST)が策定した「AIリスクマネジメントフレームワーク(AI RMF)」です。

4. 米国国立標準技術研究所(NIST)「AIリスクマネジメントフレームワーク(AI RMF)」の概要

米国国立標準技術研究所(NIST)が2023年1月に発表した「AIリスクマネジメントフレームワーク(AI RMF)」は、AI技術の設計・開発・運用・評価におけるリスクを体系的に管理するためのガイドラインです。企業や公共機関が信頼できるAIを実現するための枠組みとして、企業や公共機関が信頼できるAIを実現するために設計されています。

NIST AI RMFでは、AIのリスクを適切に管理するために、AIシステムのライフサイクル全体を通じた取り組みが重要であるとされています。

このライフサイクルは、AIの企画段階から運用・活用に至るまでの各ステージでリスクと影響を見極め整理しています。

NISTのAIリスクマネジメントフレームワーク(AI RMF)では、AIのリスクをうまく管理し、信頼できるAIをつくるために、「コア」と呼ばれる考え方が使われています。

この「コア」は、次の4つの活動(機能)でできています

①GOVERN(統治)

✓ AIのリスク管理を組織としてどう進めるか、ルールや体制を整える活動です。他の3つの活動を支える土台になります。

②MAP(把握)

✓ AIに関わるリスクを見つけて、どんな影響があるかを理解する活動です。

③MEASURE(測定)

✓ リスクの大きさやAIの性能などを、データや指標を使って評価する活動です。

④MANAGE(対応)

✓ 見つけたリスクに対して、どう対応するかを決めて実行する活動です。

以下の内容を参考にAI RMF のライフサイクルと概要を整理した。

<NIST AI 100-1AI リスクマネジメント フレームワーク(AI RMF 1.0) Artificial Intelligence Risk Management Framework (AI RMF 1.0) 閲覧日 2025/8/26>

<NIST AI リスクマネジメントフレームワークプレイブック Artificial Intelligence Risk Management Framework Playbook (AI RMF 1.0 Playbook) Japanese Translation 閲覧日 2025/8/26>

これらは、AIのライフサイクル全体にわたって継続的に実施されるべき活動であり、組織が信頼性の高いAIを実現するための土台となります。

次に、こうしたフレームワークを実際の業務にどのように適用できるのか、導入前~導入後の場面を例に、リスク評価の具体的なイメージをご紹介します。

5. 実際のリスク評価のイメージ

企業が生成AIを導入する際には、技術的な可能性だけでなく、リスクや責任の観点からの慎重な検討が不可欠です。

NISTのAIリスクマネジメントフレームワーク(AI RMF)は、導入前・導入時・運用後の各フェーズで、AIのリスクを体系的に管理するための実践的な枠組みを提供しています。

以下では、企業が生成AIを活用する際に、AI RMFの各機能(MAP、MEASURE、GOVERN、MANAGE)をどのように活用できるかを、フェーズごとに具体的に示します。

以下の内容を参考に活用イメージとチェックリストイメージを整理した

<NIST AI 100-1AI リスクマネジメント フレームワーク(AI RMF 1.0) Artificial Intelligence Risk Management Framework (AI RMF 1.0) 閲覧日 2025/8/26>

<NIST AI リスクマネジメントフレームワークプレイブック Artificial Intelligence Risk Management Framework Playbook (AI RMF 1.0 Playbook) Japanese Translation 閲覧日 2025/8/26>

このように、AI RMFを活用することで、企業は生成AIの導入に伴うリスクを事前に把握し、導入後も継続的に監視・改善する体制を整えることが可能になります。

特に、導入前の準備と運用中のモニタリングを丁寧に行うことで、予期せぬリスクの顕在化を防ぎ、信頼性の高いAI活用が実現可能になると考えます。

6. 終わりに

AIの活用を検討する企業にとって、AI技術に内在するリスクを体系的に評価・管理することは、事業継続性や信頼性を確保するうえで不可欠です。特に、法規制や倫理的配慮、情報セキュリティといった観点からのリスク対応は、企業価値の維持・向上にも直結します。

AIのリスク評価に関してのご相談がございましたら、ぜひお気軽にお問い合わせください。

お問い合わせは、以下の窓口よりお願いいたします。

Contact Us - BDO

以上